第5名解决方案

感谢大家参与这次比赛,祝贺获奖者,也要给学习者们点赞。

虽然这次比赛颇具争议,因为大多数人甚至无法击败示例提交,但我仍然认为这是一次不错的比赛。关键在于要明白数据中没有太多的信号,而且比赛的评估指标对过度自信的模型并不友好,稍后会详细说明。

由于比赛的性质(信号少,而且基本上没有公开 LB 反馈),我决定不投入太多时间,所以我对这个结果非常满意!

数据

- 颜色归一化:

- 检测背景颜色

- 通过

r = background_color / (255, 255, 255)对所有图像进行归一化

- 简单方法:

- 移除图像中所有白色块

- 调整大小至 1024x1024

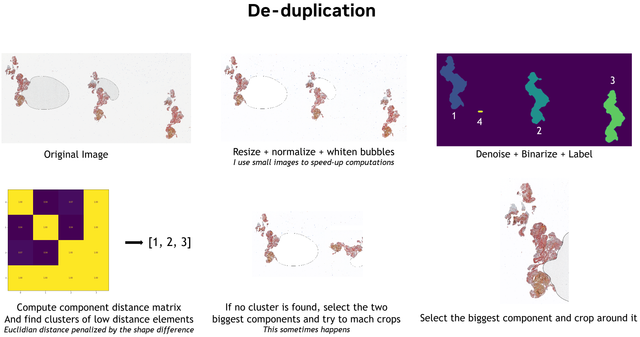

- 高级方法(见下图):

- 检测图像中的重复区域

- 仅保留其中一个

- 调整大小,使最长边为 1024,保持纵横比

你可以在此处查看一些示例。

模型

- 3个小模型 - CV AUC 0.684

- Resnet10t – AUC 0.661

- EfficientNet-b0 – AUC 0.671

- EfficientNet-b0(使用简单方法处理图像) - AUC 0.662

- 训练

- 图像尺寸:1024x1024

- Ranger + lr=5e-4 (模型 a, b) - Adam + lr = 1e-4 (模型 c)

- 使用类别平衡的 BCE 损失函数来模拟评估指标 + 标签平滑

- 10轮,批次大小 bs=16

- 翻转和颜色增强

- 推理

- 4次翻转 TTA(测试时增强)

- 简单平均

- 缩放!

适应比赛指标

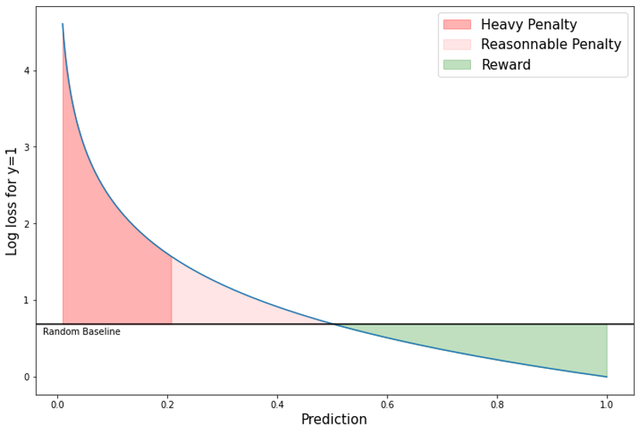

- 对数损失对自信的错误预测惩罚很重,相对于对自信的正确猜测的奖励而言:

- 由于我们的模型 AUC 较低,我们要避免进入“重惩罚”区域

- 我的集成模型已经将其大部分输出预测在“安全”范围内,这可能是因为我的模型设计初衷就是欠拟合(标签平滑、小模型尺寸、低学习率短时间训练):

- 集成 CV:0.655

- 你可以强制让你的模型更保守!(参考这篇帖子)

- 线性重新缩放到 0.15 / 0.85 范围

- 裁剪到 0.25 / 0.75

- 最终 CV:0.640 - Public LB 0.733 - Private LB 0.666

感谢阅读 :)